发布时间:2020-03-30 11:13 | 标签:

HTC AR Steam VR Valve 苹果 GDC 2020

微信扫一扫:分享

微信里点“发现”,扫一下

二维码便可将本文分享至朋友圈

Valve推出SteamVR移动应用Holoswitch,支持PC VR与智能手机交互

Holoswitch是SteamVR的移动应用程序,可在早期访问中使用,它可让用户与智能手机进行交互,而无需卸下VR头戴设备。

通过PC客户端将智能手机与计算机配对,用户可以将电话、短信、重要的应用程序通知直接转发到VR头显,从而使用户 可以与外界互动,而不会沉浸其中。通过将智能手机用作监控摄像头,用户甚至可以随时查看现实环境。

该公司在正式版本中表示:“到目前为止,虚拟现实技术的用户必须定期检查他们在现实生活中是否遗漏了某些东西”。 “一直担心错过电话,朋友或家人与用户交谈或在用户家门口等着送货,这使得长时间享受VR变得困难。”

“ Holoswitch帮助消除社交和现实世界隔离的障碍,从而使更多的人可以在更长的时间内享受VR。每当现实生活需要关注时,用户就会意识到这一点,并使他们摆脱害怕错过的恐惧。”

“如果我在VR上度过一个晚上,我总会想念一些东西。”其中一位应用程序Beta测试人员说,“在比赛进行中摘下头显或仅在手机上查看消息时,这很烦人。有了Holoswitch,我终于可以放松并在虚拟空间中闲逛更长的时间了。每当我收到消息或通知时,都可以直接在头显中看到它们。“

Holoswitch现在可在所有OpenVR兼容头显上以$ 5.99的价格购买,包括HTC Vive、Valve Index、Oculus Rift / Rift S、Oculus Quest、Windows Mixed Reality。设置非常简单。只需安装PC客户端和移动应用程序,将头显与智能手机配对,然后选择要接收的通知即可。目前,仅支持Android设备,尽管该公司承诺在不久的将来支持iOS。

虽然HTC确实是在2016年发布了自己的移动伴侣应用程序,该应用程序还允许玩家在VR时与他们的移动设备进行交互,但该应用程序非常笨拙,并且缺乏对电子邮件和基本消息传递应用程序的支持。希望Holoswitch可以为用户提供更稳定的头显内通信系统。

在游戏全面发布后,该公司希望包括几个附加功能,包括电话镜像、VR中的直接视频通话、语音转文本功能、无键盘打字、实时流媒体。

苹果发布首款AR/VR应用专利:可为用户导航的情景感知CGR数字助手

今天,美国专利商标局发布了苹果公司的专利申请,这可能是AR/VR内容相关的第一个专利申请。未来的苹果头显设备系统可能会允许用户调用情景感知CGR数字助手(Contextual CGR Digital Assistant),以在用户遇到某个困难时刻为他们提供帮助。

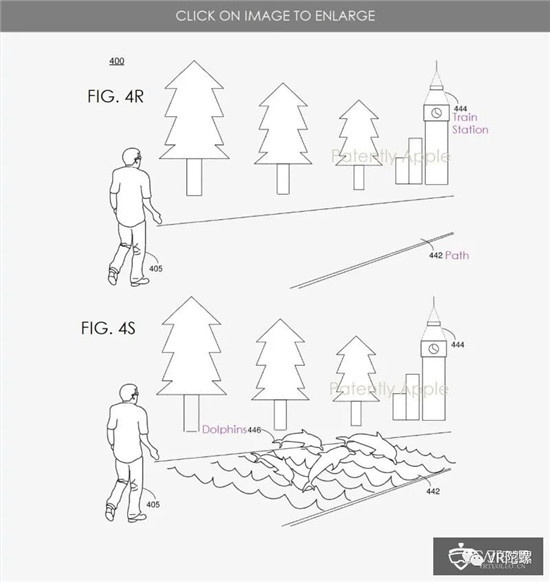

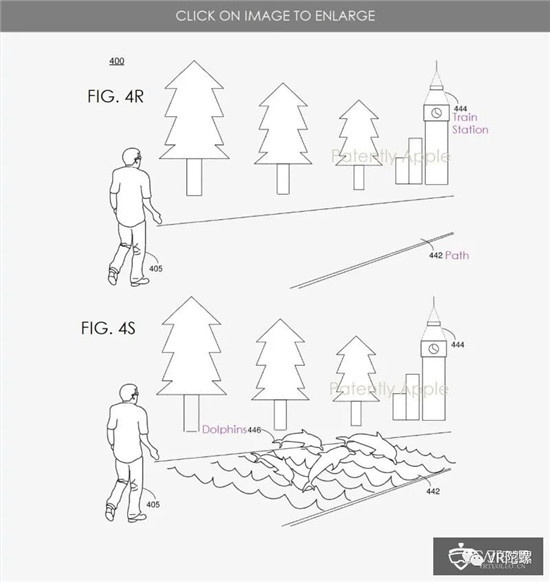

苹果公司在专利图FIGS. 4R-4T显示了上下文CGR数字助手的各种可视表示,该助手可在CGR#400环境中提供导航。

在图4R所示,用户#405正在沿着路径(#442)朝火车站(#444)。火车站444上方是时钟。时钟上显示的时间表示用户计划乘坐的火车即将到达。在一些实施方式中,情景感知CGR数字助手可以通过pass-through图像识别为用户提供车站的路径导航和引导。情景感知触发包括例如时间、用户配置文件和用户的身体姿势,或通向火车站的路径等。

海豚通常被认为是地球上最聪明的动物之一,它们可以利用地球磁场进行导航。此外,众所周知的是海豚能够与人互动。基于海豚的这些特征,如图2所示,在图4S中,海豚被选择作为情景感知CGR数字助手的视觉表示,以提供导航并将用户引导到火车站。在图4S中,路径#442上的覆盖物显示为水,海豚在水中游泳。

在一些实施方式中,情景感知提示取决于包括与用户相关联的日历事件,例如火车时间表和当前时间。例如,如果火车的发车时间和用户的当前时间较接近,需要指示用户赶火车,则计算机生成的海豚会加快游泳速度,以引导用户快速前往火车站。

另一方面,如果情景感知指示用户有足够的时间赶火车,则计算机生成的海豚可能会以相对较慢的速度朝火车站游泳。

当用户处于游戏或计算机生成的现实环境中时,如苹果所说,有时用户会“不知所措”,甚至迷失方向。更具体地说,在适当的情况下,情景感知CGR数字助手将合成到现实场景中,并响应于特定的图像数据,将信息提供给用户。因此,情景感知CGR数字助手巧妙地将用户的注意力吸引到相关的媒体内容,来帮助用户从合成现实场景中获取信息。

此外,由于情景感知CGR现实数字助手的表现形式取决于人们所期望的或与特定表示相关联的文化理解,因此使用情景感知CGR数字助手能在现实场景提供更自然的用户体验。

例如,在了解狗的快速运动能力和获取商品的能力后,当用户注意到餐厅(真实世界或CGR)时,计算机生成的狗可以用作情景感知CGR数字助手的可视表示形式,以为用户快速获取餐厅信息。

其他示例包括显示由计算机生成的猫,通过猫将用户带到有趣的地方;或由计算机生成的猎鹰飞来飞去,以给定某个区域的平面图;计算机生成的海豚(如游戏示例所示)将用户位置引导至图4R和4S等。

将这些虚拟动物形象化作为情景感知CGR数字助手的可视化表示,使用户可以从CGR环境中获取信息而不会感到不知所措。

作为非动物示例,在某些文化中,天空中的北斗七星星座能提供方向指引。基于这种文化理解,计算机生成的北斗七星星座将作为情景感知CGR数字助手显示在CGR场景中,以向用户指示方向。

情景感知CGR数字助手的工作方式可能取决于用户正在查看内容的显示类型,因为它会随VR头显、iPhone、iPad或挡风玻璃上的平视显示器而变化。

当然,情景感知CGR数字助手也将在未来应用于多种环境,以旅游业为例,智能眼镜将能够使用该数字助手来将游客导航至热门餐馆、顶级博物馆和著名景点。

从这项最新的专利申请中可以看出,苹果正在为将来的HMD系统开发潜在的新软件,这很可能只是未来HMD硬件配套软件内容的开始。

由于这是苹果的第一款AR/VR软件产品,因此很难完全理解他们的概念。但是,我们大多数人都熟悉Siri,Google助手和Alexa,而苹果的愿景是为未来的VR,AR和混合现实系统创建类似的情景感知数字助手,通过引入数字对象互动,协助我们进行导航等功能。

苹果新专利:未来头显设备或带可互换镜头的显示系统,以适应不同用户视力

1月下旬,苹果公司以专利方式发布了一份申请报告,标题为“苹果公司发明详述了用于未来的头戴式显示设备的处方镜片系统”。苹果公司的这项专利与未来的混合现实头显相关,该头显允许佩戴处方眼镜的用户将其带有度数的镜片放入头显中,从而无需在头显中额外佩戴眼镜,避免不适感。今天,美国专利商标局发布了苹果公司的另一项专利申请,其中详细介绍了未来的可更换镜头的头戴式显示器(HMD)系统以及支持该硬件的系统。

带可互换镜头的显示系统

头戴式显示器(HMD)是戴在用户头上的一种显示设备,包括一个或多个用于向用户显示图形的显示模块。不同的使用者可能具有不同的视力,因此需要佩戴不同的矫正眼镜。

苹果的发明涵盖了显示系统。在一个实施方式中,显示系统包括显示器,可移动透镜组件和透镜检测传感器。

可移动镜头能够移动耦合到显示器。镜头检测传感器能够检测耦合到显示器的可移动镜头组件。该显示系统还可以包括头戴式显示单元,该头戴式显示单元包括显示器和镜头检测传感器。显示系统可以利用透镜检测传感器从可移动透镜确定透镜信息,并且可以根据透镜信息提供可移动透镜的指示符。

在另一实施方式中,提供了一种用于操作头戴式显示单元的方法,该方法包括:识别耦合至头戴式显示单元的显示模块的可移动镜头;以及根据该可移动镜头的识别来提供指示。该指示可以是在可移动透镜和可耦合至显示模块的另一块可移动透镜之间不同的配置指示。该方法可以进一步识别用户,而该指示可以是可移动镜片和用户之间的兼容性指示。

在该实施方式中,显示系统包括头戴式显示单元和可移动透镜组件。其中头戴式显示单元包括显示模块。可移动透镜组件包括透镜元件和联接至透镜元件的框架。可移动透镜组件可以以单个定向移动到显示模块,其中磁性附接特征耦合到框架并且围绕透镜元件。

最后,可根据不同使用者的眼睛特征(例如,根据眼镜度数)来配置可互换镜片。例如,一对可互换的镜片可以与一个用户相关联(例如,规定给一个用户)。可互换的镜头可安装到头戴式显示单元,使得头戴式显示单元能够适应具有不同眼镜度数的用户。

苹果的专利图1是显示系统的侧视图,其具有以虚线示出的隐藏组件;图2是图1显示系统的剖视图。图1沿图2的2-2线截取。图13E是处于部分结合状态的显示模块的剖视图。

更具体地说,苹果的专利图1和2是VR或混合现实显示系统以及一个或多个可移动镜头组件#120的一部分。

参考专利图13E:为了将可拆卸镜头组件#1320耦合到显示模块#1310,首先将镜头机械耦合部件#1322插入到显示器机械耦合部件1#312中,然后旋转可拆卸透镜组件从而让磁耦合部件#1324和#1314彼此靠磁耦合。

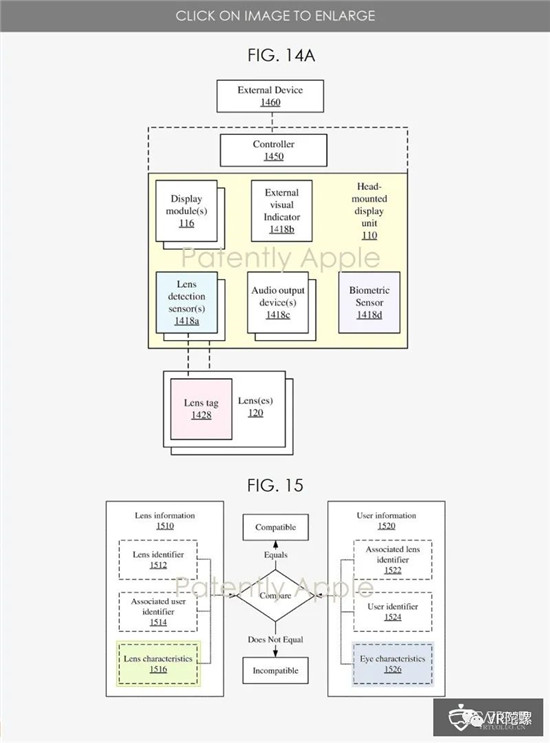

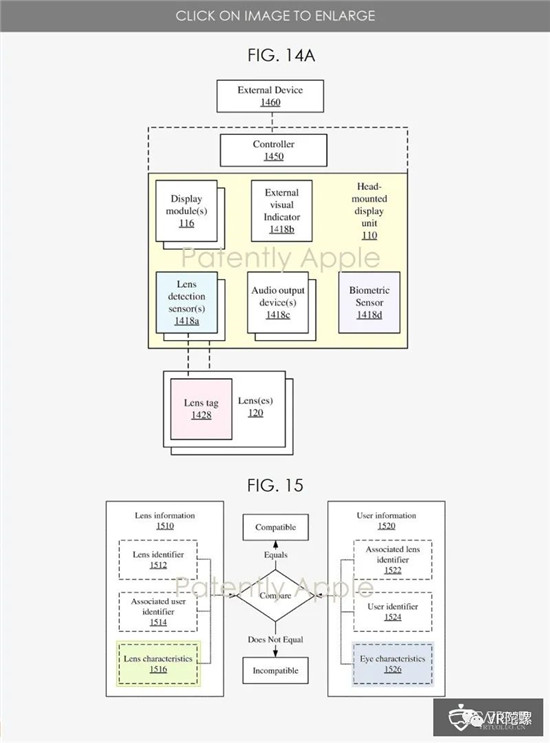

苹果的专利图14A是显示系统的示意图;图15是用于确定可移动镜头与用户兼容性的过程的流程图。

参照图14A,显示系统#100可以使用耦合的可移动透镜组件#120的透镜信息来确定与用户的兼容性,并以此向用户提供兼容性指示符。

除了确定耦合至头戴式显示单元的可移动镜头组件的镜头信息之外,显示系统还标识当前用户,并将用户信息与镜头信息进行比较以确定兼容性。

显示系统可以以各种方式来识别用户,例如,通过生物特征感测,用户凭证的接收或另一设备的认证。为了通过生物特征识别用户,显示系统可以包括生物特征传感器#1418d,以利用生物特征(例如,面部识别、指纹识别、语音识别、虹膜识别或其他生物特征参数识别来判断用户几何形状、骨骼传导或密度特征、前额特征或皮肤等)。

生物识别传感器物理耦合至头戴式显示单元。例如,在利用虹膜检测识别用户的情况下,生物特征传感器可以是针对眼睛的摄像机。

为了识别用户,显示系统可从其输入设备或与之相关联的输入设备(例如,头戴式显示单元的麦克风或外部设备)接收用户认证(例如,用户名和密码),从而与控制器或头戴式显示单元通信。

为了通过来自另一设备的认证来识别用户,外部设备可以对用户进行认证并将其传达给控制器。外部设备可以被认为是显示系统的一部分,但可以独立于其运行(例如,iPhone)。

美国专利局于今天发布的这款苹果公司专利申请已于2019年第二季度提交。考虑到这是专利申请,目前尚不知道这种产品何时能够上市。

苹果正测试新AR头显及应用,或将使用类似Vive的控制手柄

近年来,苹果公司对增强现实(AR)的兴趣众所周知,并且有传言称该公司正在开发AR头显,且该项目已经进行了很长时间的开发。现在,新的证据表明,苹果的这项计划比以往更接近完成状态。

根据MacRumors的说法,即将发布的iOS 14操作系统的泄露版本包含一张照片,该照片似乎是AR/VR或将两者结合在一起的称为“混合现实”头显设备的控制器。

它看起来与HTC Vive Focus所用的控制器非常相似,后者是目前市场上的另一款VR头显设备。这很重要,因为有传言称苹果与HTC方面拥有悠久的合作历史。彭博社(Bloomberg)在2017年报道说,两家公司正在合作开发AR头显。这张最新照片可能表明该合作伙伴关系还很健康。

2020年3月,9to5Mac在iOS 14 Beta中找到了代码,这表明苹果正在开发一个名为“ Gobi”的新AR应用程序。虽然该应用程序似乎适用于iPhone(例如,当人们在Apple Store中查看产品时可实现AR体验),但人们认为Apple可以使用它来测试其混合现实头显项目。

MacRumors还认为,苹果公司正在为其新生的头显测试AR人行横道保龄球游戏。该应用程序将允许用户过马路时的等待时间玩一款保龄球相关的虚拟游戏。目前,该游戏只能在加利福尼亚州桑尼维尔的555 N. Mathilda Ave附近的一个交叉路口触发,该交叉口位于苹果公司名为“ Mathilda 3”的办公室附近。靠近该办公室意味着这可能是苹果正在开发其头显的地方。

HTC将在线上举行其所有GDC 2020演讲

由于冠状病毒的爆发(COVID-19),今年的游戏开发者大会(GDC)被迫取消。但一些公司决定在网上给大家分享他们的开发者见解,HTC宣布会从现在到5月中旬的每个星期二在网络上进行实时网络研讨会。

从3月31日到5月12日,HTC将会直播开发人员的现场对话,这本将在GDC 2020上进行的。

HTC还将在每个会话之后主持问答环节,该会话将在每周二(太平洋标准时间)上午10点进行。HTC也会将所有视频都上传到其YouTube频道。

3月31日,星期二–领先一步:利用数据趋势打造成功的VR体验

4月7日,星期二–打造明天:VIVE手动跟踪SDK

4月14日,星期二–使用Vive Sync在VR中远程工作

4月21日,星期二–100 + VR游戏的营销经验

4月28日,星期二– Viveport开发人员控制台:2020年将会发生什么

5月5日,星期二– XR Continuum:VR和AR结合发展

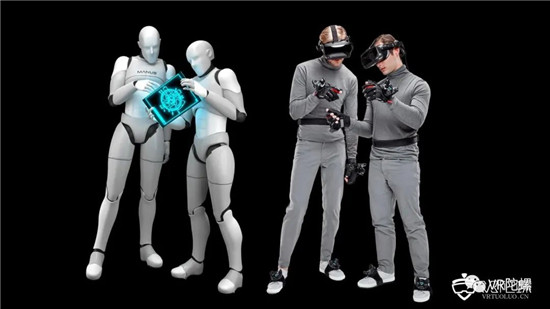

Manus VR公布全身跟踪技术解决方案Polygon

近日,科技企业Manus VR推出最新产品Manus Polygon,这是一款全身式的VR解决方案,并且可能支持多用户协作。它仅需要使用5个Vive追踪器,Polygon即可生成自然的身体运动。借助可提供手部跟踪功能的Manus手套,该解决方案进一步增强增强,并有助于整合用户的身体动作,从而提供更身临其境的体验。

多年来,Manus致力于数据手套的开发,在去年成功发布其Prime系列后,Manus现在目标是通过发布Polygon来提高沉浸式技术开发的门槛。该公司指出,Polygon适用于各种应用程序,包括VR体验,培训和模拟以及虚拟协作。

Polygon的关键属性之一是用户可以自行校准,无需来自VR体验之外的任何干预。仅需5个Vive跟踪器,设置硬件就很简单,并使用户可以轻松进入Polygon。跟踪器分配在校准期间自动完成。Polygon IK系统读取Vive跟踪器的运动并计算用户的自然运动。

Polygon可以在本地或通过现有网络提供多用户支持。这使Polygon用户可以彼此连接并共享其虚拟工作区。多用户系统的工作原理是让一个用户充当运行模拟的主机,但可以允许来宾加入环境。

第一时间了解XR资讯

关注VR陀螺官网(vrtuoluo.cn)

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)