【编译 VR陀螺】6月29日消息,谷歌研究人员开发了一个端到端6DoF视频系统 ,它甚至可以通过(高带宽)互联网连接进行流媒体传输。

众所周知,360视频可以带观看者身临其境感受异国风情或者奇幻世界,在这种场景下观看者可以转头查看周围的场景,但却不能实际移动头部往向前或向后的位置。这种体验会让观看者觉得整个世界都被自己的脑袋锁住了,这和真正身在某地是完全不一样的。

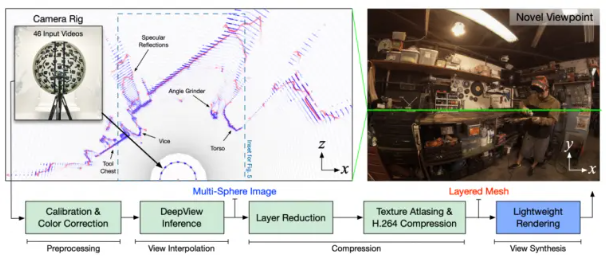

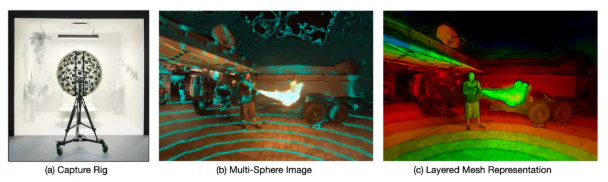

谷歌的新系统将整个360视频的堆栈、捕获、重建、压缩和渲染整个制作流程进行了封装,将其集中在一整套半自动化的全景拍摄系统中。该相机配备了46台同步的4K相机,以每秒30帧的速度运行,每个摄像头都配有一个“低成本”的丙烯酸弧形支架。由于丙烯酸是半透明的,它甚至可以作为取景器使用。

每台相机的零售价为160美元,整机售价要比钻井平台的7000美元零售价还要略高。但是,听起来这套系统所需要的价格很高,但是实际上如果你选择这套原有系统的定制替代品,那么成本要低得多,其拍摄效果并不会大打折扣。希望从这一系统开始,6DoF视频真正成为可落地的新技术被广泛应用。

使用这套系统进行拍摄,结果是你会得到一个长220厘米、宽70厘米的“光场”环境——这也是观看者头部可以进行6DOF移动的最大范围。最终,360视频的分辨率可以达到10像素/度,这意味着除了HTC Vive之外,任何现有的VR头显观看都会有些模糊。就像所有的新生技术一样,我们希望它会随着时间的推移而改进。

但真正令人印象深刻的是这套系统对于360视频的压缩和渲染。上述范围的光场内可以通过流畅的300mbit /sec互联网连接来制作视频后期。尽管这还是远远超过了平均网速,但现在大多数大城市都能够提供这种带宽。

2019年,谷歌的人工智能研究人员开发了一种名为DeepView的机器学习算法。通过输入同一场景的4张图片,从不同的角度DeepView可以生成深度图,甚至可以从任意的角度生成新的图片。

这个新的6DoF视频系统使用了改良版的DeepView。该算法使用一组球壳材质代替2D平面来表示场景。通过一种新的算法将这个输出重新处理为更小的shell数量。最后,这些球形图层被转换成一个更轻的“分层网格”,它从纹理图集中采样,以进一步节省资源(这是游戏引擎中使用的一种技术,不同模型的纹理被存储在同一个文件中,紧密地打包在一起)。

光场视频仍然是一个新兴的技术,处于早期阶段。所以,短时间内YouTube这种视频平台不会在不久的将来开始支持光场视频。但显然,这一发明对于VR内容的发展是里程碑式的,这让原始的360视频变为可串流的6DoF视频,至少这现在已经成为了被解决的问题。

随着研究成果的发布,谷歌很快会将这套系统应用在成型的产品之中,我们将密切关注这项技术。

来源:uploadvr

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息