编译/VR陀螺

LiDAR为苹果手机与平板带来了深度感知能力,谷歌则正通过ARCore帮助安卓设备制造商在深度感知能力上缩小与苹果的差距。

在本周二的I/O主题演讲中,谷歌发布ARCore 1.24版本,该版本主要带来了两项新的AR功能:Raw Depth API和Recording and Playback API,前者可在无LiDAR装置的情况下帮助安卓设备提高AR体验并实现更为准确的遮挡效果。

Raw Depth API是通过捕获其他深度数据在现有Depth API的基础上构建,以便应用程序可以通过标准的智能手机摄像头呈现逼真的AR体验。不过即便如此,带有TOF传感器进行深度测量的安卓设备提供的AR体验与之相比质量更高。

(左)《TikTok》(中)《AR Doodada》(右)《3D Live Scanner》

(左)《TikTok》(中)《AR Doodada》(右)《3D Live Scanner》

图源:谷歌

Google AR产品经理Ian Zhang和Zeina Oweis表示:“新的ARCore Raw Depth API通过生成带有相应置信度图像的'原始'深度图,让场景中呈现的几何物体细节更加丰富。这些原始深度图包括未经过平滑处理的数据点,置信度图像会为原始深度图中的每个像素提供深度估计的置信度。”

其结果就是几何形状识别度增强,深度测量的精度更高,并且对于将AR内容实际锚定到物理环境时的环境理解效果更好。

《TikTok》是最早利用Raw Depth API的应用程序之一。该应用程序的“绿屏投影器”(Green Screen Projector)效果可以在Raw Depth API对用户相机胶卷中的照片具有高置信度的情况下包装对象。

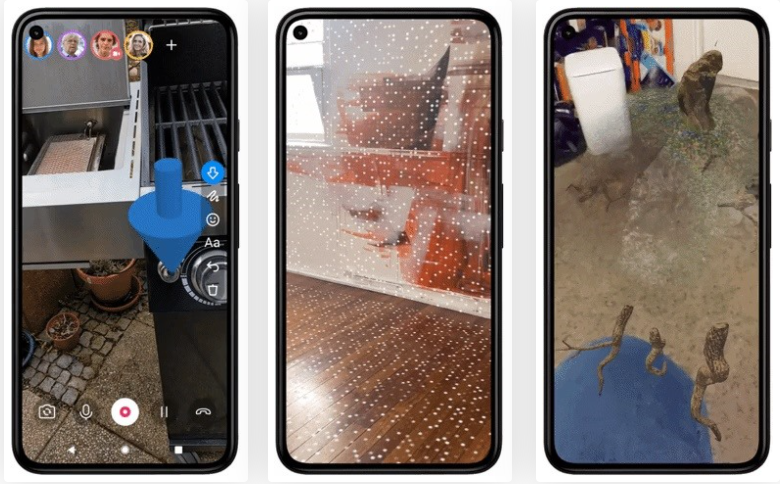

(左)《LifeAR》(中)《ARConnect》(右)《Snapchat》

图源:谷歌

其他早期采用者包括虚拟鲁布·戈德堡机械游戏《AR Doodads》、测量应用程序《AR Connect》、3D扫描应用程序《3D Live Scanner》和Teamviewer用于提供远程协作的《lifeAR》等。

此外,借助Recording and Playback API,ARCore使应用程序能够捕获视频镜头中的惯性测量单位(IMU)和深度数据。换句话说,开发人员不必花钱在各种实际环境中测试AR应用程序。

Recording and Playback API为用户创建了一种新型的AR体验,用户可以将虚拟内容添加到视频中。例如,SK Telecom的《JumpAR》让用户能够与定位在韩国的视频进行交互并添加AR内容。不仅如此,由Nexus Studios制作的《VoxPlop!》 能让用户在视频中添加3D角色并与他人共享,接受共享的人还可使用AR内容对其进行编辑。

(左)《JumpAR》(右)《VoxPlop!》

(左)《JumpAR》(右)《VoxPlop!》

图源:谷歌

谷歌会在ARCore新功能会议上更深入地介绍这些功能。

有趣的是,谷歌最先通过其Tango硬件平台推出了深度传感器,在当时,仅两种商用设备支持搭载。对此,苹果公司通过推出ARKit采用软件策略做出回应,而后,谷歌也随之改变原有的硬件策略,转而推出ARCore。

现在苹果为苹果手机及平板搭载深度传感器LiDAR,谷歌却通过提升软件功能来应对。

来源:Next.Reality

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息