文/VR陀螺 万里

去年以来,消费电子市场上出现了三款颇具代表性的AI新品:智能眼镜形态的Ray-Ban Meta、可穿戴投影设备Humane Ai Pin以及今年CES期间亮相的掌机形态的Rabbit R1。

对比来看可以发现、近期Ai Pin在体验方面已经“翻车”,Rabbit R1被质疑与AI手机趋同,热度逐渐变淡。相反,Ray-Ban Meta无论是在销量以及反馈方面相较于前两者都要优秀得多,Meta团队称已经提高眼镜的生产计划,并于本月为眼镜全面开放多模态AI能力。

在眼镜发展之路上,Ray-Ban Meta究竟做对了什么?对于国内一众AR厂商而言,它又有何借鉴意义?

.png)

AI“三巨头”,图源:VR陀螺

舍弃屏幕

功能在前代基础之上进一步打磨

Ray-Ban Meta发布于去年9月,当时它与Quest 3一同亮相,产品起售价299美元,与上一代保持一致,镜片可以定制,镜片起售价17美元起步。

Ray-Ban Meta可以视为Meta与雷朋合作打造的Ray-Ban Stories(发布于2021年)的常规升级款,两者均没有配备光学屏幕,内置了定向扬声器、麦克风、摄像头等组件,可用于FPV拍摄/视频录制、通话、听音乐等。

虽然两者功能大同小异,不过根据市场反馈来看,第二代产品显然要成功得多。

去年华尔街日报透露,初代产品Ray-Ban Stories从2021年9月—2023年2月累计售出30万副,预计它的生命周期销量为39.4万副,略低于47.8万副的内部目标。而更为惨淡的是产品的活跃度,截至2023年2月,设备月活只有2.7万,不足10%。

而对于Ray-Ban Meta而言,早些时候,扎克伯格在财报会议中指出,这款眼镜在“销量和参与度方面均取得了良好的开局”;近日,Meta博客指出,“眼镜的销售速度比我们的生产速度还要快”,团队正着手于推出更多新款式;此外,也有消息称,Ray-Ban Meta去年Q4季度出货量已经超过30万副。

.png)

Ray-Ban Meta,图源:Meta

用户对于初代眼镜产品的批评主要集中在电池寿命、音频质量、语音命令以及媒体传输等方面,而Ray-Ban Meta在这些地方均进行了相应的改进:

续航方面,眼镜配备了新的高通AR1处理器,单次连续使用时长可达4小时,配合充电盒可达到36小时;

改进音频体验,新的扬声器具有更大音量以及更强低音效果,此外,眼镜配备5麦克风阵列,(初代为三阵列)有效提升了语音交互体验,甚至能录制空间音频;

摄像头像素提升至1200万,新增拍摄物理按键,拍照视频表现均有所提升,并支持在眼镜端进行Instagram和Facebook直播;

产品进一步降低重量(约49g)以及提升了佩戴舒适度,并支持IPX4防水等级。

.png)

Ray-Ban Meta成为了扎克伯格出游的高频装备,图源:Instagram

从亚马逊平台的反馈来看,Ray-Ban Meta某款商品链接收获了4.4分(5分制)的评价,其中5星好评率达到72%,好评率高于绝大多数“智能眼镜”品类下的同类型商品。

而在这些好评当中,用户的核心场景主要包括:第一人称视角拍摄(这在做饭、旅游等场景下会比较实用)、听音乐(有人将其当成了AirPods的替代品)、手机通知播报等。

图源:亚马逊

这背后其实可以表明目前以Ray-Ban Meta为代表的智能眼镜产品定义并没有太大问题,因而用户活跃度问题则可以基于硬件迭代而得到进一步提升。值得一提的是,早些时候,Meta内容生态系统总监Chris Pruett也曾表示,Quest 3设备的用户活跃度以及留存率也要高于以往的头显产品,这同样得益于产品的持续迭代以及改进。

AI将作为Ray-Ban Meta新的体验壁垒

相较于初代产品,Ray-Ban Meta除升级影像和佩戴体验外,其实还有一项重磅功能更新:Meta AI。

Meta AI是一个多模态人工智能,最早亮相于去年Meta Connect大会,当时Meta计划逐步将其引入到Facebook、Instagram、Quest 3以及Ray-Ban Meta等软硬件产品矩阵当中。对于Ray-Ban Meta而言,Meta AI于去年12月在美国地区启动了抢先体验,并于本月正式面向美国和加拿大用户推出。

眼镜用户可以通过“Hey Meta”指令唤起AI,除了用于询问天气、制定闹钟、对话交流外,用户还能通过“Hey Meta,look And......”指令调用摄像头以实现更多视觉化的操作,如你可以将眼镜摄像头对准冰箱,然后询问AI里面的食材可以用于做什么菜、识别眼前的建筑、询问花园中某种植物所需的浇水量等。

Ray-Ban Meta发布会展示的AI场景,图源:Meta

此外,Meta AI具备一定的上下文理解能力,如果用户对于生成的内容不满意,还可以进一步增加限定词以提升准确率。

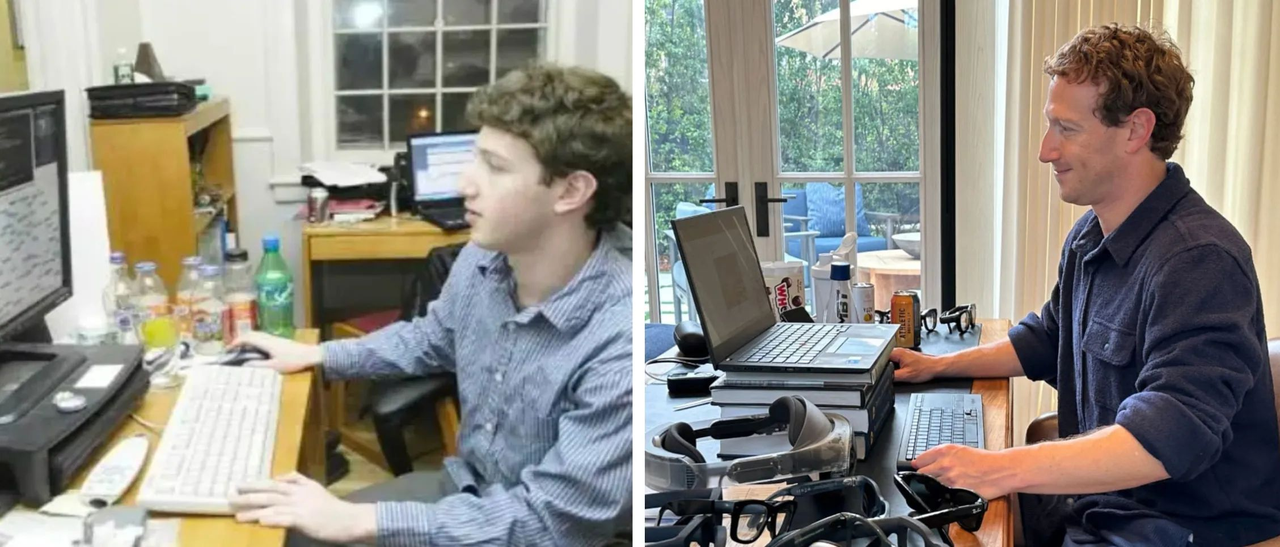

扎克伯格度假时测试眼镜的AI功能,图源:Instagram

其他方面,Meta AI支持翻译功能,目前AI支持英语、西班牙语、意大利语、法语、德语五种语言。由于眼镜的AI能力需要基于云端实现,因而需要预留一定的响应时间,不过在可接受范围。不仅如此,用户在眼镜端的AI聊天内容还可以通过配套的手机APP《Meta View》进行回看。

如果对比来看,可以发现Ray-Ban Meta与Ai Pin不乏相似之处,两款都是可穿戴式设备,双方都押宝于AI,并且积极打造多模态AI体验。此外,两款产品都并不侧重于显示,前者没有屏幕,后者则使用简单的投影代替。不过,从用户口碑来看,两款产品则具有明显差异,我觉得可以归结为以下几方面因素:

图源:网络

一方面,Ray-Ban Meta是眼镜形态,而Ai Pin是胸章形态,前者易用性会更高,并且在拍照等场景下体验会更好。此外,Ray-Ban Meta目前仍将拍照、音乐等基础功能作为核心体验,并且功能已经打磨得相对不错,相比之下Ai Pin在续航、发热、系统稳定性、拍照等方面仍存在较多问题。

对于AI功能而言,我们参照各大媒体评测就能发现无论是Ray-Ban Meta或者Ai Pin,它们在这方面都远算不上完美,“AI翻车”事件更是频频传出。不过Ray-Ban Meta十分聪明地将AI作为一项测试版功能更新,而Ai Pin则将AI作为了宣传重点,这就导致它极大提高了用户预期,这也是导致Ai Pin出现诸多恶评的重要原因所在。

目前陀螺君暂时没办法比较两者的AI能力,不过从投入力度来看,Ray-Ban Meta的上限应该会高于Ai Pin。近日Meta已经发布了基于最新开源大语言模型Llama 3的Meta AI,部分性能甚至已经超过GPT-4。

此外,Meta团队还在为AR/智能眼镜构建更多种类的AI能力,如上个月其公布了一种用于3D环境理解的训练方法:SceneScript,它可以使用端到端机器学习直接推断房间等几何形状,当其应用于眼镜中将能使设备获得更多环境理解能力,如测量桌子的长度等。此外,Meta还在训练LLM使之在眼镜端能够输出更简短而准确的回复,这有利于改善用户体验。

先眼镜后AR,下一步叠加显示

目前Meta Reality Labs正在致力于推进头显与AR眼镜两条产品线,其中由于AR眼镜技术难度更高,短期内推出能够同时满足“光学、佩戴、续航”三大需求的消费级产品显然难度过大,因而Meta退而求其次选择了与眼镜厂商雷朋合作开发智能眼镜产品,以试探市场的反应。在这个过程中,Meta团队提供软件和技术支持,而雷朋团队则负责设计和销售。

2021年所发布的Ray-Ban Stories是双方合作打造的首款产品,产品立项之初团队曾定下了三大准则:兼顾外形与功能、提供第一人称视角、让用户停留在当下,即更加侧重于眼镜的时尚与佩戴这一属性。

初代产品,图源:Meta

智能眼镜以外,Meta带有屏幕方案的眼镜产品也已经在规划中,有消息称今年Meta将展示一款代号为Orion的AR眼镜原型,该产品或采用Micro-LED+碳化硅光波导方案,不过并不对外发售。

而下一款消费级AR眼镜产品(同样是Ray-Ban合作款)则有望在明年推出,它配备了显示屏幕,并会进一步引入肌电手环作为交互。屏幕的引入将能进一步拓宽眼镜产品的功能边界,它除了能够接收视觉信息外,还能进一步增强AI助手的能力。

扎克伯格展示AR眼镜原型,图源:Threads

Meta初代智能眼镜配备了双摄像头,最初旨在实现空间视频拍摄,但由于完成度问题功能被砍,第二代产品转为了单摄,不排除下一代产品会回归双摄方案。

其他方面,有调研机构称,下一代智能眼镜产品或将配备LCoS+阵列光波导方案,随着屏幕的加入,299美元的售价也可能会成为过去式。

图源:Meta

从Ray-Ban Meta看当前AR眼镜发展的两条路径

早些时候,AAC AR产品经理曹皓然曾提到,智能眼镜(市场上也有人称之为音频眼镜)在麦克风方案、扬声器方案上都与AR眼镜有高度重合,双方的一大核心区别其实在于有没有配备显示屏幕。这意味着两种产品形态具有一定相通性,过渡起来并不会十分复杂。

不过,基于市场现有产品来看,目前似乎除了Meta以外,智能眼镜厂商与AR眼镜厂商表现得泾渭分明,双方安于一隅,并不会轻易考虑另一种形态。基于此,其实衍生出了另外一个问题:企业究竟应该从智能眼镜做起,又或者是直接发展AR眼镜?(下文特指信息提示类AR眼镜)

来源:VR陀螺

Meta无疑选择了前者:先发展智能眼镜产品,随后叠加AR显示。由于智能眼镜舍弃了屏幕,功能不可避免会相对单薄,不过它的好处在于产品形态方面能实现更好的控制,尽量趋近于普通的眼镜/墨镜。

基于这一前提下,华为、Meta进一步与GENTLE MONSTER、雷朋眼镜厂商合作,通过将智能眼镜与普通眼镜做锚定,这能在一定程度上降低用户的教育成本并吸引用户买单。

目前我们已经可以很清楚看到未来AR眼镜将出现的两项独一无二的增量功能更新,一是AI的落地,二是屏幕的加入。显示功能自然十分重要,但现阶段离开了它其实也并非难以忍受的缺陷。

Meta早些时候也在其博客文章中直言:得益于过去 18 个月人工智能模型的快速突破,我们现在认为,我们在全面 AR 眼镜之路上所拥有的智能眼镜将具有更广泛的吸引力,并且比我们之前想象的更有用——即使没有显示器。

总而言之,Meta认为AI在眼镜设备的成熟以及落地速度可能会高于显示,智能眼镜的价值也会因为AI的出现进一步被放大。

华为初代智能眼镜,图源:网络

实际上,现在已经有越来越多厂商看到了“智能眼镜”类产品的价值并加大了投入,据Bloomberg透露,苹果正在积极探索包括智能指环、智能眼镜在内的可穿戴式设备,它的智能眼镜或与Ray-Ban Meta类似,通过标配扬声器、摄像头等以满足用户对于听音乐、轻量化拍摄以及AI助理的需求。

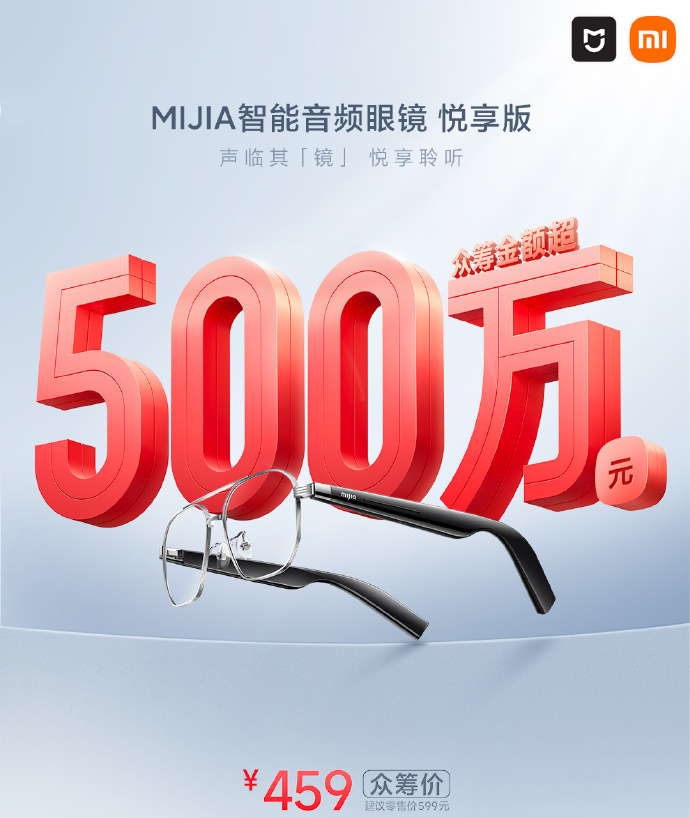

而上个月,米家商城上线了MIJIA智能音频眼镜悦享版,产品只保留了听音乐、通话等核心功能,并将重量控制在了37.7g,目前产品众筹销量已经突破了10000台。

图源:小米商城

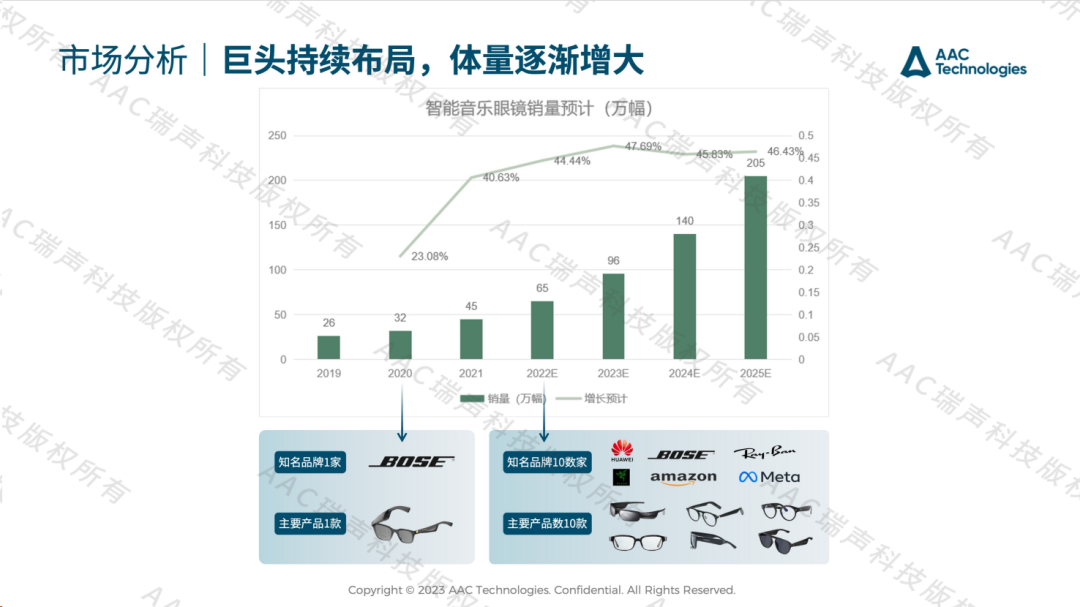

从一些出货量数据来看,去年智能眼镜的出货量已经接近百万级,而AR眼镜全年销量约50万(一体式AR眼镜产品占比并不高),智能眼镜出货量要明显高于带屏幕的产品。为什么带显示、功能更多的AR眼镜销量反而不及智能眼镜?

图源:AAC瑞声科技

毋庸置疑的是,智能眼镜加上显示,能拓展更多维度,让信息显示更直观便捷,而现阶段探索的很多场景,如信息提示、导航、翻译、提词等等,在笔者看来都是非常有价值的场景,只是直到现在,大部分企业的技术重心都在解决硬件层存在的问题,如显示部分的屏幕、分辨率、视场角、光效、eyebox、均匀性、彩虹纹,以及产品结构、ID、续航、体积、重量等。

而经过这些年努力,在硬件层已经实现了较大的突破,双目显示一体机能实现40g左右的重量,并且续航时间也基本可满足日常使用(非长时间连续使用),在所有人全力推进硬件发展的同时,软件端显然还有诸多可改进之处。

硬件只是基础,真正能体现AR眼镜价值的恰恰是软件层。如翻译场景,在收音、识别、准确率、实时性以及大段连续翻译上并没有达到理想的状态;信息提示场景下,信息提示的形式,提示内容的选择等等;AI方面,能联动的APP丰富性,以及自然语言指令等。深究细节,实际上那个场景都有很大的提升空间。

基于陀螺君对于身边AR眼镜用户的观察,他们对于眼镜屏幕的使用频次其实并不高,核心应用场景还是聚焦于智能眼镜听音乐、通话、接收手机消息通知等方面。

因而回顾Ray-Ban Meta这款产品以及Meta对于未来AR硬件的规划,我们可以发现,从智能眼镜切入、完善现有体验再拓展显示能力,其实也不失为一个优秀的借鉴思路。

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)

版权申明:本文为VR陀螺原创,任何第三方未经授权不得转载。如需转载请联系微信:vrtuoluo233 申请授权,并在转载时保留转载来源、作者以及原文链接信息,不得擅自更改内容,违规转载法律必究。文中有图片、视频素材来自互联网或无法核实出处,如涉及版权问题,请联系本网站协商处理。

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息